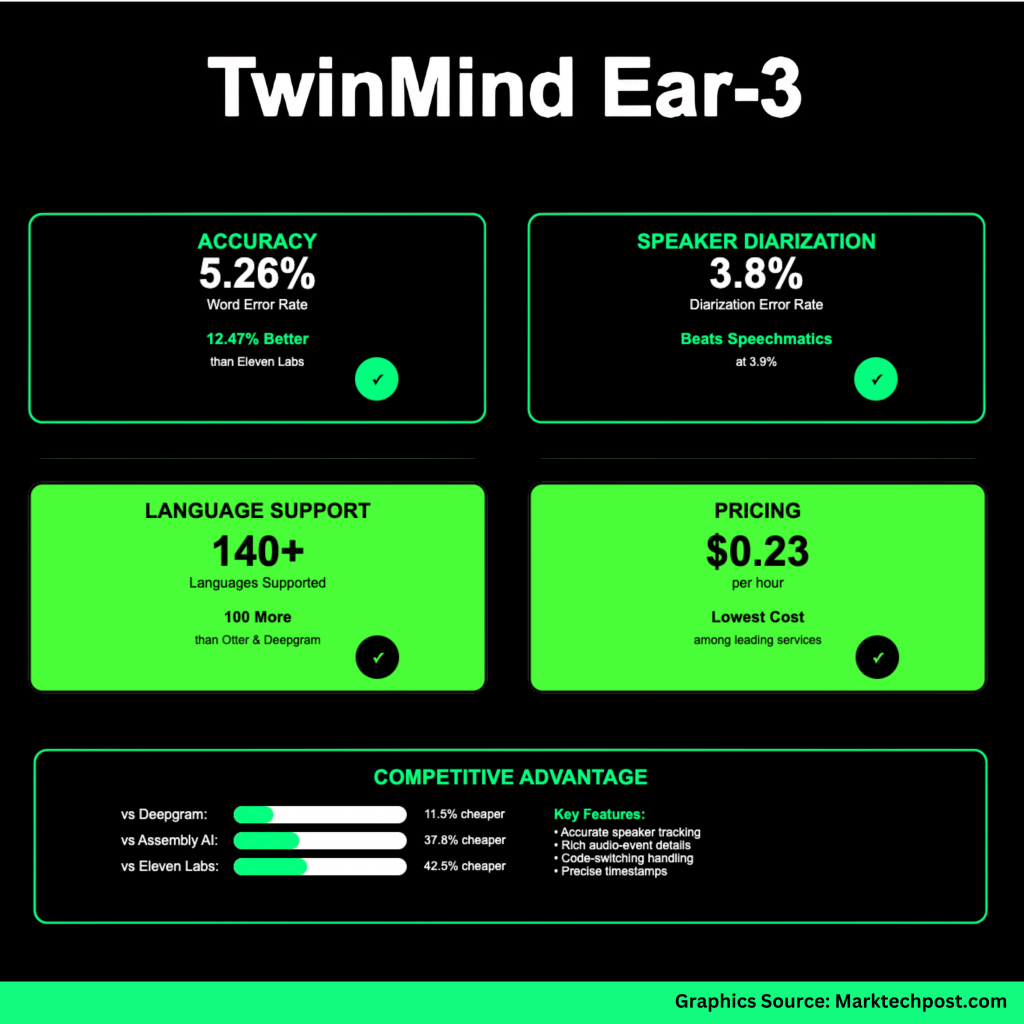

نموذج TwinMind Ear-3: ثورة في دقة التعرف على الكلام بأسعار لا تُصدق

أعلنت شركة TwinMind، وهي شركة ناشئة متخصصة في تقنيات الذكاء الاصطناعي للصوت ومقرها كاليفورنيا، عن إطلاق نموذجها الجديد للتعرف على الكلام، Ear-3، والذي يدعي تحقيق أداء متطور على عدة مقاييس رئيسية، بالإضافة إلى دعم متعدد اللغات غير مسبوق. يُضع هذا الإصدار Ear-3 في موقع تنافسي قويّ أمام حلول التعرف الآلي على الكلام (ASR) من شركات رائدة مثل Deepgram و AssemblyAI و Eleven Labs و Otter و Speechmatics و OpenAI.

المقاييس الرئيسية:

- معدل خطأ الكلمات (WER): 5.26%. أقل بكثير من العديد من المنافسين، حيث يبلغ معدل الخطأ في Deepgram حوالي 8.26%، وفي AssemblyAI حوالي 8.31%.

- معدل خطأ تحديد المتحدث (DER): 3.8%. تحسين طفيف مقارنة بأفضل النتائج السابقة من Speechmatics (حوالي 3.9%).

- دعم اللغات: أكثر من 140 لغة. أكثر من 40 لغة إضافية مقارنة بالعديد من النماذج الرائدة، مع هدف تحقيق “تغطية عالمية حقيقية”.

- التكلفة لكل ساعة من النسخ: 0.23 دولار أمريكي/ساعة. أقل تكلفة بين الخدمات الرئيسية.

النهج التقني والموقع:

تشير TwinMind إلى أن Ear-3 هو “مزيج مُحسّن من عدة نماذج مفتوحة المصدر”، تم تدريبه على مجموعة بيانات مُدققة تحتوي على مصادر صوتية مُعلّقة يدويًا، مثل البودكاست والفيديوهات والأفلام. تم تحسين عملية تحديد المتحدث وتسميته من خلال خط أنابيب يتضمن تنظيف الصوت وتحسينه قبل تحديد المتحدث، بالإضافة إلى “فحوصات محاذاة دقيقة” لتحسين تحديد حدود المتحدث. يتعامل النموذج مع تبديل الكود والكتابات المختلطة، والتي تُعَدّ عادةً صعبة على أنظمة التعرف على الكلام بسبب اختلافات الصوتيات، وتباين اللهجات، والتداخل اللغوي.

المقايضات والتفاصيل التشغيلية:

- السحابة: يتطلب Ear-3 نشرًا على السحابة. نظرًا لحجم النموذج وحمولة الحوسبة، لا يمكن استخدامه بشكل كامل دون اتصال بالإنترنت. يبقى نموذج TwinMind السابق (Ear-2) بديلاً في حالة انقطاع الاتصال.

- الخصوصية: تدعي TwinMind عدم تخزين الصوت لفترة طويلة؛ يتم تخزين النصوص فقط محليًا، مع إمكانية النسخ الاحتياطي المشفر اختياريًا. يتم حذف التسجيلات الصوتية “فوريًا”.

- تكامل النظام الأساسي: من المخطط توفير وصول واجهة برمجة التطبيقات (API) للنموذج في الأسابيع القادمة للمطورين/الشركات. بالنسبة للمستخدمين النهائيين، سيتم طرح وظائف Ear-3 في تطبيقات TwinMind لنظامي iOS و Android و Chrome خلال الشهر القادم للمستخدمين المحترفين.

التحليل المقارن والآثار:

تضع مقاييس WER و DER لـ Ear-3 في المقدمة أمام العديد من النماذج الراسخة. يُترجم انخفاض WER إلى عدد أقل من أخطاء النسخ (الأخطاء في التعرف، والكلمات المحذوفة، إلخ)، وهو أمر بالغ الأهمية في مجالات مثل المجال القانوني والطبي، ونسخ المحاضرات، أو أرشفة المحتوى الحساس. وبالمثل، فإن انخفاض DER (أي فصل المتحدثين وتسميتهم بشكل أفضل) مهم في الاجتماعات والمقابلات والبودكاست – أي شيء يتضمن مشاركين متعددين.

يجعل سعر 0.23 دولار أمريكي/ساعة النسخ عالي الدقة أكثر جدوى اقتصاديًا للصوت طويل الأمد (مثل ساعات الاجتماعات، والمحاضرات، والتسجيلات). إلى جانب دعم أكثر من 140 لغة، هناك دفعة واضحة لجعل هذا النموذج قابلاً للاستخدام في الإعدادات العالمية، وليس فقط في سياقات اللغة الإنجليزية أو اللغات الغنية بالموارد.

ومع ذلك، قد يكون الاعتماد على السحابة قيدًا للمستخدمين الذين يحتاجون إلى إمكانيات دون اتصال أو أجهزة طرفية، أو حيث تكون مخاوف خصوصية البيانات/الانتقال مهمة. قد تكشف تعقيدات التنفيذ لدعم أكثر من 140 لغة (انحراف اللهجات، واللهجات، وتبديل الكود) عن نقاط ضعف في ظل ظروف صوتية غير مواتية. قد يختلف الأداء في العالم الحقيقي مقارنة بمعايير الاختبار المُتحكم فيها.

الخاتمة:

يمثل نموذج TwinMind Ear-3 ادعاءً تقنيًا قويًا: دقة عالية، ودقة في تحديد المتحدث، وتغطية لغوية واسعة، وخفض كبير في التكلفة. إذا ثبتت معايير الأداء في الاستخدام الفعلي، فقد يُغيّر هذا التوقعات لما ينبغي أن تقدمه خدمات النسخ “المميزة”.

اترك تعليقاً