نماذج لغة “كوين” من علي بابا: ثورةٌ في عالم النماذج اللغوية الصغيرة

قدم فريق “كوين” التابع لشركة علي بابا نموذجين لغويين صغيرين قويين: Qwen3-4B-Instruct-2507 و Qwen3-4B-Thinking-2507. على الرغم من احتوائهما على 4 مليارات بارامتر فقط، إلا أنهما يقدمان قدرات استثنائية في المهام العامة والمتخصصة، مع القدرة على التشغيل بكفاءة على أجهزة المستهلك. يتميز كلا النموذجين بنوافذ سياقية تصل إلى 256 ألف رمز (Token)، مما يسمح لهما بمعالجة مدخلات طويلة للغاية مثل قواعد بيانات ضخمة، وأرشيفات متعددة الوثائق، وحوارات مطولة، دون الحاجة إلى تعديلات خارجية.

التصميم الأساسي والهندسة المعمارية

- عدد المعلمات: 4 مليارات معلمة (3.6 مليار معلمة بدون تضمينات الكلمات).

- الطبقات: 36 طبقة من محولات الترانسفورمر.

- آلية الانتباه: تستخدم آلية “Grouped Query Attention (GQA)” مع 32 رأس استعلام و 8 رؤوس مفتاح/قيمة، مما يعزز الكفاءة وإدارة الذاكرة للسياقات الكبيرة جدًا.

- الهندسة المعمارية: تعتمد على هندسة محولات الترانسفورمر الكثيفة، وليس خليط الخبراء، مما يضمن أداءً متسقًا في المهام المختلفة.

- الدعم السياقي: دعم سياقي يصل إلى 262,144 رمز مدمج مباشرةً في بنية النموذج.

- التدريب: خضع كلا النموذجين لتدريب مكثف قبل عملية المحاذاة والسلامة لضمان نتائج عالية الجودة ومسؤولة.

Qwen3-4B-Instruct-2507: نموذج متعدد اللغات يتبع التعليمات

يُعدّ نموذج Qwen3-4B-Instruct-2507 مُحسّنًا للسرعة والوضوح واتباع التعليمات المُوجهة للمستخدم. وهو مصمم لتقديم إجابات مباشرة دون تفصيل خطوات التفكير، مما يجعله مثاليًا للحالات التي يرغب فيها المستخدمون في الحصول على استجابات موجزة بدلاً من عمليات تفكير مفصلة.

- اللغات: يدعم أكثر من 100 لغة، مما يجعله مناسبًا للنشر العالمي في روبوتات الدردشة، ودعم العملاء، والتعليم، والبحث متعدد اللغات.

- الدعم السياقي: يُمكنه معالجة مهام مثل تحليل الوثائق القانونية الكبيرة، ومعالجة النصوص الطويلة، أو تلخيص مجموعات البيانات الضخمة دون تقسيم المحتوى.

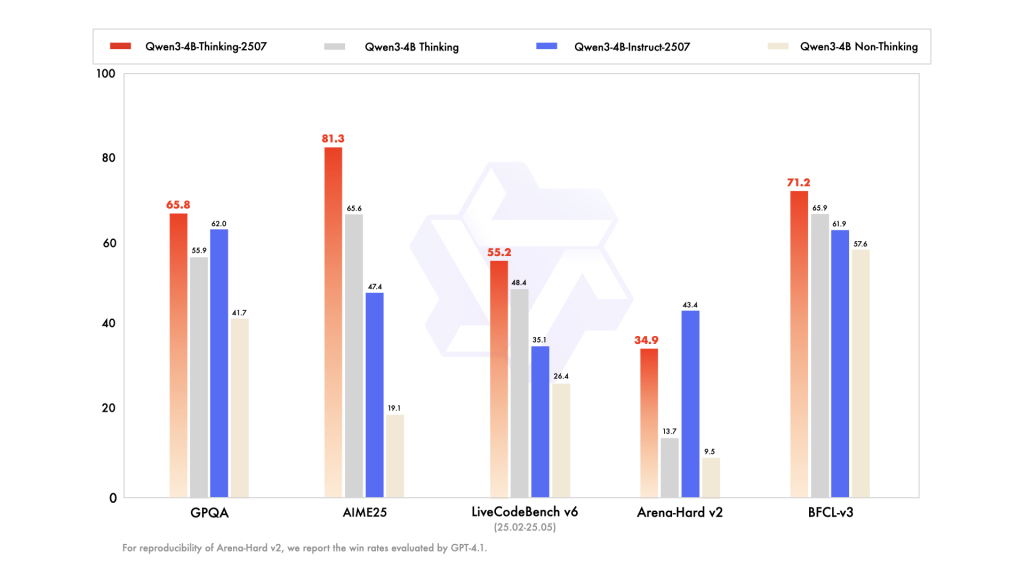

معايير الأداء:

| المعيار | النتيجة |

|---|---|

| المعرفة العامة (MMLU-Pro) | 69.6% |

| التفكير المنطقي (AIME25) | 47.4% |

| أسئلة وأجوبة (SuperGPQA) | 42.8% |

| البرمجة (LiveCodeBench) | 35.1% |

| الكتابة الإبداعية | 83.5% |

| الفهم متعدد اللغات (MultiIF) | 69.0% |

Qwen3-4B-Thinking-2507: نموذج للتفكير المتسلسل على مستوى الخبراء

على عكس نموذج Instruct الذي يركز على الاستجابة الموجزة، صُمّم نموذج Qwen3-4B-Thinking-2507 للتفكير العميق وحل المشكلات. فهو يُنشئ تلقائيًا سلاسل تفكير واضحة في مخرجاته، مما يجعل عملية اتخاذ القرارات شفافة – وهو أمر مفيد بشكل خاص في المجالات المعقدة مثل الرياضيات والعلوم والبرمجة.

- المجالات: يبرع في التشخيص التقني، وتفسير البيانات العلمية، والتحليل المنطقي متعدد الخطوات.

- التطبيقات: يُناسب الوكلاء المتقدمين للذكاء الاصطناعي، ومساعدي البحث، ورفاق البرمجة الذين يحتاجون إلى التفكير في المشكلات قبل الإجابة.

معايير الأداء:

| المعيار | النتيجة |

|---|---|

| الرياضيات (AIME25) | 81.3% |

| العلوم (HMMT25) | 55.5% |

| أسئلة وأجوبة عامة (GPQA) | 65.8% |

| البرمجة (LiveCodeBench) | 55.2% |

| استخدام الأدوات (BFCL) | 71.2% |

| المحاذاة البشرية | 87.4% |

المزايا المشتركة لكلا النموذجين

- نافذة السياق: نافذة سياقية مدمجة تصل إلى 256 ألف رمز.

- التحسين: تحسينات في عملية المحاذاة، مما ينتج استجابات أكثر طبيعية واتساقًا ووعيًا بالسياق في المحادثات الإبداعية ومتعددة الأدوار.

- جاهزية الوكيل: جاهزية للعمل كوكيل، مع دعم الاتصال بالواجهة البرمجية، والتفكير متعدد الخطوات، وتنسيق سير العمل.

- الكفاءة: كفاءة عالية، وقدرة على التشغيل على وحدات معالجة الرسومات (GPUs) الرئيسية للمستهلكين مع الكميّة لتقليل استخدام الذاكرة، ومتوافق تمامًا مع أطر الاستدلال الحديثة.

النشر والتطبيقات العملية

يُسهّل النشر بفضل التوافق الواسع مع الأطر، مما يُمكّن من تكامله مع أي خط أنابيب حديث للتعلم الآلي. ويمكن استخدامه في الأجهزة الطرفية، ومساعدي المؤسسات الافتراضيين، ومؤسسات البحث، وبيئات البرمجة، والاستوديوهات الإبداعية.

أمثلة على سيناريوهات الاستخدام:

وضع اتباع التعليمات:

- روبوتات دعم العملاء.

- مساعدين تعليميين متعددي اللغات.

- إنشاء محتوى في الوقت الفعلي.

وضع التفكير:

- تحليل البحوث العلمية.

- التفكير القانوني.

- أدوات برمجة متقدمة.

- الأتمتة الوكيلة.

الخلاصة

يُثبت نموذجا Qwen3-4B-Instruct-2507 و Qwen3-4B-Thinking-2507 أن النماذج اللغوية الصغيرة يمكن أن تُنافس بل وتتفوق على النماذج الأكبر حجمًا في مجالات محددة عند تصميمها بعناية. يُعدّ مزيج معالجة السياق الطويل، والقدرات المتعددة اللغات القوية، والتفكير العميق (في وضع التفكير)، وتحسينات المحاذاة، أدوات قوية لكل من تطبيقات الذكاء الاصطناعي اليومية والمتخصصة. مع هذه الإصدارات، وضعت علي بابا معيارًا جديدًا في جعل نماذج الذكاء الاصطناعي عالية الأداء جاهزة لـ 256 ألف رمز في متناول المطورين في جميع أنحاء العالم.

اترك تعليقاً