محرك فيديو بوز (ViPE): ثورة في معالجة الفيديو ثلاثي الأبعاد لتطبيقات الذكاء المكاني

يُعَدّ إنشاء مجموعات بيانات ثلاثية الأبعاد لتدريب أنظمة الذكاء الاصطناعي في مجال الروبوتات عمليةً مكلفةً ومعقدةً. ولكن، أحدث باحثون من NVIDIA نقلةً نوعيةً في هذا المجال من خلال إطلاقهم “محرك فيديو بوز (ViPE): محرك معالجة الفيديو ثلاثي الأبعاد للإدراك الهندسي”، وهو حلٌّّ مبتكرٌ يُعالج إحدى أكبر التحديات التي واجهت مجال رؤية الحاسوب ثلاثية الأبعاد لسنوات طويلة.

ماهية محرك فيديو بوز (ViPE)

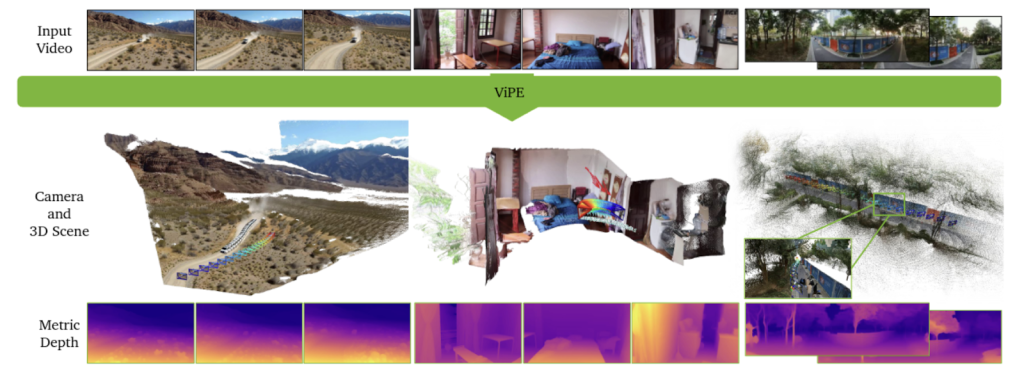

يُعدّ ViPE محركًا قويًا ومتعدد الاستخدامات مصممًا لمعالجة لقطات الفيديو الخام غير المُقيدة، وذلك لاستخراج العناصر الأساسية للواقع ثلاثي الأبعاد، بما في ذلك:

- المعلمات الداخلية للكاميرا (معايرة المستشعر): تحديد دقة بيانات الكاميرا.

- حركة الكاميرا الدقيقة (الموضع): تحديد حركة الكاميرا بدقة.

- خرائط العمق المترية الكثيفة (المسافات في العالم الحقيقي لكل بكسل): تحديد المسافة بدقة لكل بكسل في الصورة.

التحدي: استخراج الواقع ثلاثي الأبعاد من الفيديو ثنائي الأبعاد

يهدف الذكاء الاصطناعي المكاني إلى تمكين الآلات والروبوتات والمركبات ذاتية القيادة ونظارات الواقع المعزز من إدراك التفاعل مع العالم ثلاثي الأبعاد. لكنّ غالبية بياناتنا المسجلة، من مقاطع الفيديو على الهواتف الذكية إلى الأفلام السينمائية، محصورة في بعدين. تكمن المشكلة الأساسية في كيفية هندسة الواقع ثلاثي الأبعاد المخبّأ داخل تيارات الفيديو ثنائية الأبعاد بشكل موثوق وقابل للتوسع. يُعدّ تحقيق ذلك بدقة من مقاطع الفيديو اليومية، التي تتميز بحركات غير ثابتة وأشياء ديناميكية وأنواع كاميرات غير معروفة، عمليةً صعبةً للغاية، إلا أنها خطوة أساسية لأي تطبيق مكاني متقدم.

مشاكل الحلول الحالية

لعدة عقود، كان المجال مضطراً لاختيار أحد نموذجين قويين ولكنهما معيبان:

1. مصيدة الدقة (طرق SLAM/SfM التقليدية)

تعتمد الأساليب التقليدية مثل تحديد الموقع والرسم الخرائطي المتزامن (SLAM) وبناء البنية من الحركة (SfM) على تحسين هندسي مُعقد. إنها قادرة على تحقيق دقة عالية في ظل ظروف مثالية. لكنّ عيبها الرئيسي هو هشاشتها. فهذه الأنظمة تفترض عمومًا أن العالم ثابت. أضف سيارة متحركة أو جدارًا عديم الملمس أو استخدم كاميرا غير معروفة، وسيتعطل إعادة البناء بأكمله. إنها حساسة للغاية للواقع الفوضوي لمقاطع الفيديو اليومية.

2. جدار قابلية التوسع (التعلم العميق من الطرف إلى الطرف)

ظهرت مؤخرًا نماذج قوية للتعلم العميق. من خلال التدريب على مجموعات بيانات ضخمة، تتعلم “المفاهيم المسبقة” القوية حول العالم، وهي قادرة على تحمل الضوضاء والديناميكية بشكل مثير للإعجاب. لكنّ عيبها الرئيسي هو صعوبة التعامل معها. تتزايد متطلبات الذاكرة لهذه النماذج مع زيادة طول الفيديو، مما يجعل معالجة مقاطع الفيديو الطويلة عمليةً مستحيلةً عمليًا. ببساطة، لا تتوسع هذه النماذج.

أوجد هذا المأزق معضلةً. يُطالب مستقبل الذكاء الاصطناعي المتقدم بمجموعات بيانات ضخمة مُعلّمة بهندسة ثلاثية الأبعاد مثالية، لكن الأدوات اللازمة لإنشاء هذه البيانات كانت إما هشة للغاية أو بطيئة للغاية ليتم نشرها على نطاق واسع.

محرك فيديو بوز (ViPE): إنجاز هجين من NVIDIA

هنا يأتي دور ViPE لتغيير قواعد اللعبة. إنه ليس مجرد تحسين تدريجي؛ بل هو خط أنابيب هجين مُصمم جيدًا ومتكامل بنجاح يجمع أفضل ما في العالمين. فهو يأخذ إطار التحسين الرياضي الفعال من SLAM الكلاسيكية ويحقنه بالحدس القوي المُتعلم من الشبكات العصبية العميقة الحديثة. يسمح هذا التآزر لـ ViPE بأن يكون دقيقًا وقويًا وفعالًا ومتعدد الاستخدامات في نفس الوقت. يقدم ViPE حلاً قابلًا للتوسع دون المساومة على الدقة.

كيفية عمل محرك فيديو بوز (ViPE)

تستخدم بنية ViPE إطارًا قائمًا على الإطار الرئيسي لضبط الحزمة (BA) لتحقيق الكفاءة. إليك الابتكارات الرئيسية:

1. تآزر القيود القوية

يحقق ViPE دقة غير مسبوقة من خلال الموازنة الماهرة بين ثلاث مدخلات أساسية:

- التدفق الكثيف (القدرة على تحمل الصدمات المُتعلمة): يستخدم شبكة تدفق بصري مُتعلم لمطابقات قوية بين الإطارات، حتى في الظروف الصعبة.

- المسارات المتناثرة (الدقة الكلاسيكية): يُدمج تتبع الميزات التقليدي عالي الدقة لالتقاط التفاصيل الدقيقة، مما يُحسّن دقة تحديد الموقع بشكل كبير.

- تنظيم عمق متري (المقياس في العالم الحقيقي): يُدمج ViPE المفاهيم المسبقة من نماذج العمق أحادية العين المتطورة لإنتاج نتائج بمقياس متري حقيقي في العالم الحقيقي.

2. إتقان المشاهد الديناميكية في العالم الحقيقي

للتعامل مع فوضى مقاطع الفيديو في العالم الحقيقي، يستخدم ViPE أدوات تقسيم أساسية متقدمة، GroundingDINO و Segment Anything (SAM)، لتحديد وتمييز الأشياء المتحركة (مثل الأشخاص والسيارات). من خلال تجاهل هذه المناطق الديناميكية بذكاء، يضمن ViPE حساب حركة الكاميرا بناءً على البيئة الثابتة فقط.

3. السرعة العالية والتنوع العام

يعمل ViPE بسرعة 3-5 إطارًا في الثانية على وحدة معالجة رسومات واحدة، مما يجعله أسرع بكثير من الأساليب المماثلة. علاوة على ذلك، يُمكن تطبيق ViPE عالميًا، ويدعم نماذج الكاميرات المتنوعة، بما في ذلك الكاميرات القياسية والكاميرات ذات الزاوية الواسعة/عين السمكة، وحتى مقاطع الفيديو البانورامية 360 درجة، مع تحسين المعلمات الداخلية تلقائيًا لكل منها.

4. خرائط عمق عالية الدقة

يتم تعزيز الإخراج النهائي من خلال خطوة معالجة لاحقة متطورة. يقوم ViPE بمحاذاة خرائط العمق عالية التفاصيل بسلاسة مع الخرائط المتسقة هندسيًا من عملية التشغيل الأساسية. النتيجة مذهلة: خرائط عمق عالية الدقة وثابتة زمنيًا.

الأداء المُثبت

يُظهر ViPE أداءً متفوقًا، متجاوزًا خطوط الأساس الحالية لتقدير الوضعية غير المُعايرة بنسبة مذهلة:

- 18% على مجموعة بيانات TUM (ديناميكيات داخلية).

- 50% على مجموعة بيانات KITTI (قيادة خارجية).

من المهم أن تؤكد التقييمات أن ViPE يوفر مقياسًا متريًا دقيقًا، بينما غالبًا ما تُنتج الأساليب/المحركات الأخرى مقاييس غير متسقة وغير قابلة للاستخدام.

الابتكار الحقيقي: انفجار البيانات للذكاء الاصطناعي المكاني

لا تُعدّ المساهمة الأكثر أهمية لهذا العمل المحرك نفسه، بل نشره كمصنع لتعلييم البيانات على نطاق واسع لتغذية مستقبل الذكاء الاصطناعي. كان نقص البيانات الضخمة والمتنوعة المُعلّمة هندسيًا للفيديو هو العائق الرئيسي لتدريب نماذج ثلاثية الأبعاد قوية. يُحلّ ViPE هذه المشكلة!

استخدم فريق البحث ViPE لإنشاء وإصدار مجموعة بيانات غير مسبوقة تضم حوالي 96 مليون إطار مُعلّم:

- Dynpose-100K++: حوالي 100,000 مقطع فيديو من العالم الحقيقي من الإنترنت (15.7 مليون إطار) مع مواضع عالية الجودة وهندسة كثيفة.

- Wild-SDG-1M: مجموعة ضخمة من مليون مقطع فيديو عالي الجودة تم إنشاؤها بواسطة الذكاء الاصطناعي (78 مليون إطار).

- Web360: مجموعة بيانات متخصصة من مقاطع الفيديو البانورامية المُعلّمة.

يُوفر هذا الإصدار الضخم الوقود اللازم للجيل القادم من نماذج الأساس الهندسية ثلاثية الأبعاد، وهو يُثبت بالفعل أنه مفيد في تدريب نماذج توليد العالم المتقدمة مثل Gen3C و Cosmos من NVIDIA.

من خلال حلّ النزاعات الأساسية بين الدقة والمتانة وقابلية التوسع، يُوفر ViPE الأداة العملية والفعالة والمتعددة الاستخدامات اللازمة لإطلاق العنان للبنية ثلاثية الأبعاد لأي فيديو تقريبًا. إن إطلاقه مُعدّ لتسريع الابتكار بشكل كبير عبر المشهد بأكمله للذكاء الاصطناعي المكاني والروبوتات والواقع المعزز/الافتراضي.

روابط التحميل والمزيد من المعلومات:

- موقع البحث في NVIDIA

- مستودع كود ViPE على GitHub

- [مجموعات البيانات على Hugging Face](https://huggingface.co/datasets/nvidia/vipe-dynpose-100kpp, https://huggingface.co/datasets/nvidia/vipe-wild-sdg-1m, https://huggingface.co/datasets/nvidia/vipe-web360)

- موقع NVIDIA Cosmos

(تم دعم هذا المقال برعاية من فريق NVIDIA.)

اترك تعليقاً