MapAnything: هندسة معمارية متقدمة لإعادة بناء المشاهد ثلاثية الأبعاد

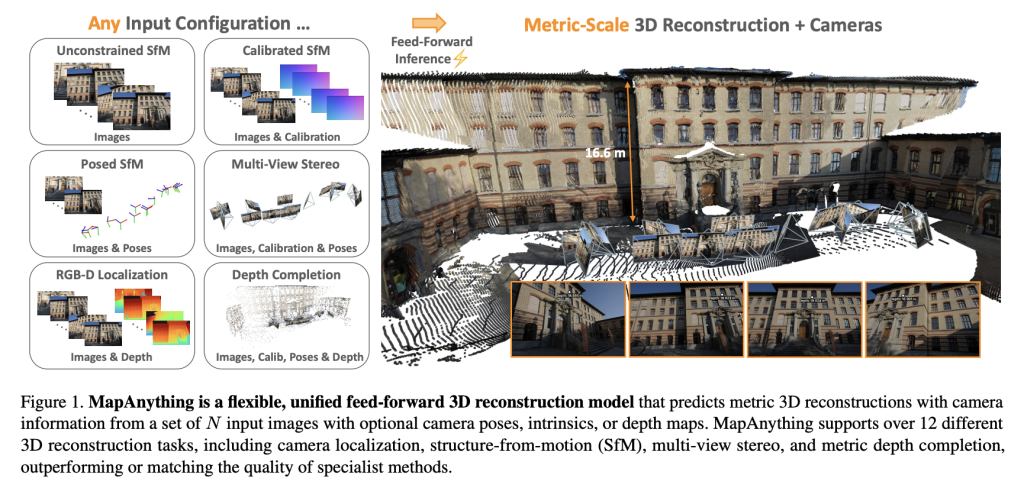

أعلن باحثون من مختبرات الواقع الافتراضي في ميتا وجامعة كارنيجي ميلون عن MapAnything، وهي هندسة معمارية متطورة تعتمد على مُحوِّلات (Transformers) لإعادة بناء هندسة المشاهد ثلاثية الأبعاد بدقة مترية، وذلك مباشرة من الصور ومدخلات أجهزة الاستشعار الاختيارية. تم إصدار MapAnything برخصة Apache 2.0 مع توفير كامل الشيفرة المصدرية للتدريب والمعايير، متجاوزة بذلك خطوط الأنابيب المتخصصة من خلال دعم أكثر من 12 مهمة مختلفة لرؤية ثلاثية الأبعاد في تمريرة واحدة فقط. رابط الورقة البحثية

لماذا نموذج شامل لإعادة البناء ثلاثي الأبعاد؟

اعتمدت إعادة بناء المشاهد ثلاثية الأبعاد القائمة على الصور تاريخيًا على خطوط أنابيب مجزأة، تشمل: كشف المميزات، تقدير الوضعية من صورتين، التعديل الكلي، الاستريو متعدد الرؤى، أو الاستنتاج أحادي الرؤية للعمق. وبالرغم من فعاليتها، إلا أن هذه الحلول المعيارية تتطلب ضبطًا محددًا للمهمة، وتحسينات، ومعالجة لاحقة مكثفة. وقد بسّطت نماذج التغذية الأمامية الحديثة القائمة على المُحوِّلات، مثل DUSt3R و MASt3R و VGGT، أجزاءً من هذا الخط، لكنها ظلت محدودة: أعداد ثابتة من الرؤى، افتراضات ثابتة للكاميرا، أو الاعتماد على تمثيلات مقترنة تتطلب تحسينات باهظة التكلفة.

يتغلب MapAnything على هذه القيود من خلال:

- قبول ما يصل إلى 2000 صورة مدخلة في عملية استنتاج واحدة.

- استخدام البيانات المساعدة بشكل مرن، مثل خصائص الكاميرا الداخلية، والوضعية، وخرائط العمق.

- إنتاج عمليات إعادة بناء ثلاثية الأبعاد مترية مباشرة دون تعديل كلي.

يوفر التمثيل المفصّل للمشهد في النموذج – المُكوّن من خرائط الأشعة، والعمق، والوضعية، وعامل مقياس عالمي – مرونة وشمولية لا تضاهى في المقاربات السابقة.

الهندسة المعمارية والتمثيل

في جوهره، يستخدم MapAnything مُحوِّلًا متعدد الرؤى ذي انتباه متناوب. يتم ترميز كل صورة مدخلة باستخدام مميزات DINOv2 ViT-L، بينما يتم ترميز المدخلات الاختيارية (الأشعة، العمق، الوضعية) في نفس فضاء الكمون عبر شبكات CNN ضحلة أو MLPs. يسمح رمز المقياس القابل للتعلم بتطبيع المقياس عبر الرؤى. يُخرج الشبكة تمثيلًا مفصلًا:

- اتجاهات الأشعة لكل رؤية (معايرة الكاميرا).

- العمق على طول الأشعة، مُتوقع حتى المقياس.

- وضعيات الكاميرا بالنسبة لرؤية مرجعية.

- عامل مقياس متري واحد يحوّل عمليات إعادة البناء المحلية إلى إطار متسق عالميًا.

يُجنّب هذا الفصل الواضح التكرار، مما يسمح لنفس النموذج بالتعامل مع تقدير العمق أحادي الرؤية، والاستريو متعدد الرؤى، وهندسة الحركة من البنية (SfM)، أو إكمال العمق بدون رؤوس متخصصة.

استراتيجية التدريب

تم تدريب MapAnything عبر 13 مجموعة بيانات متنوعة تغطي المجالات الداخلية والخارجية والاصطناعية، بما في ذلك BlendedMVS، وMapillary Planet-Scale Depth، وScanNet++، وTartanAirV2. تم إصدار نوعين:

- نموذج مرخص برخصة Apache 2.0 تم تدريبه على ست مجموعات بيانات.

- نموذج مرخص برخصة CC BY-NC تم تدريبه على جميع مجموعات البيانات الثلاثة عشر لتحقيق أداء أقوى.

تشمل استراتيجيات التدريب الرئيسية:

- إسقاط المدخلات الاحتمالي: أثناء التدريب، يتم توفير مدخلات هندسية (أشعة، عمق، وضعية) باحتمالات متفاوتة، مما يمكّن من المتانة عبر التكوينات غير المتجانسة.

- أخذ العينات القائمة على التشارك في الرؤية: يضمن أن تكون للرؤى المدخلة تداخلات ذات مغزى، مما يدعم إعادة البناء لما يصل إلى أكثر من 100 رؤية.

- الخسائر المفصّلة في مساحة اللوغاريتم: يتم تحسين العمق والمقياس والوضعية باستخدام خسائر انحدار مستقلة عن المقياس وقوية لتحسين الاستقرار.

تم إجراء التدريب على 64 وحدة معالجة رسومية من طراز H200 بدقة مختلطة، ونقاط تفتيش التدرج، والجدولة المناهجية، مع تغيير حجم من 4 إلى 24 رؤية مدخلة.

نتائج المقارنة المعيارية

إعادة البناء الكثيفة متعددة الرؤى:

على ETH3D و ScanNet++ v2 و TartanAirV2-WB، يحقق MapAnything أداءً متطورًا في خرائط النقاط، والعمق، والوضعية، وتقدير الأشعة. يتجاوز خطوط الأساس مثل VGGT و Pow3R حتى عند الحد من الصور فقط، ويتحسن أكثر مع المعايرة أو المعلومات الأولية للوضعية. على سبيل المثال:

- يتحسن الخطأ النسبي لخريطة النقاط (rel) إلى 0.16 بالصور فقط، مقارنةً بـ 0.20 لـ VGGT.

- مع الصور + الخصائص الداخلية + الوضعيات + العمق، ينخفض الخطأ إلى 0.01، مع تحقيق أكثر من 90٪ من نسب المتطابقات.

إعادة البناء من صورتين:

مقارنةً بـ DUSt3R و MASt3R و Pow3R، يتفوق MapAnything باستمرار في دقة المقياس والعمق والوضعية. بشكل ملحوظ، مع المعلومات الأولية الإضافية، يحقق أكثر من 92٪ من نسب المتطابقات في مهام صورتين، وهو ما يتجاوز بكثير نماذج التغذية الأمامية السابقة.

المعايرة أحادية الرؤية:

على الرغم من عدم تدريبه خصيصًا لمعايرة الصور المفردة، يحقق MapAnything متوسط خطأ زاويا قدره 1.18 درجة، متفوقًا على AnyCalib (2.01 درجة) و MoGe-2 (1.95 درجة).

تقدير العمق:

في مقياس Robust-MVD: يضع MapAnything معيارًا جديدًا لتقدير العمق المتري متعدد الرؤى. باستخدام المدخلات المساعدة، تتنافس معدلات خطئه مع نماذج العمق المتخصصة مثل MVSA و Metric3D v2 أو تتجاوزها.

بشكل عام، تؤكد المقاييس المعيارية تحسنًا بمقدار الضعف على طرق SoTA السابقة في العديد من المهام، مما يثبت فوائد التدريب الموحد.

المساهمات الرئيسية

يبرز فريق البحث أربع مساهمات رئيسية:

- نموذج تغذية أمامية موحد قادر على التعامل مع أكثر من 12 إعدادًا للمشكلة، من العمق أحادي الرؤية إلى SfM والاستريو.

- تمثيل مشهد مفصل يسمح بالفصل الصريح بين الأشعة والعمق والوضعية والمقياس المتري.

- أداء متطور عبر معايير متنوعة مع تكرارات أقل وقابلية أكبر للتطوير.

- إصدار مفتوح المصدر يشمل معالجة البيانات، ونصوص التدريب، والمعايير، والأوزان المدربة مسبقًا بموجب ترخيص Apache 2.0.

الخاتمة

يُنشئ MapAnything معيارًا جديدًا في رؤية ثلاثية الأبعاد من خلال توحيد مهام إعادة البناء المتعددة – SfM، والاستريو، وتقدير العمق، والمعايرة – تحت نموذج مُحوِّل واحد مع تمثيل مشهد مفصل. لا يتفوق فقط على الأساليب المتخصصة عبر المعايير، بل يتكيف بسلاسة مع المدخلات غير المتجانسة، بما في ذلك الخصائص الداخلية، والوضعية، والعمق. مع وجود كود مفتوح المصدر، ونماذج مدربة مسبقًا، ودعم لأكثر من 12 مهمة، يضع MapAnything الأساس لعمود فقري عام الغرض حقًا لإعادة بناء ثلاثية الأبعاد.

رابط الورقة البحثية رابط صفحة المشروع رابط جيثب رابط تويتر رابط ريديت رابط النشرة البريدية

اترك تعليقاً