الاستنتاج الموازي في نماذج اللغات الكبيرة: ثورة في كفاءة المعالجة

مقدمة

حققت نماذج اللغات الكبيرة (LLMs) تقدماً ملحوظاً في قدراتها على الاستدلال، كما يتجلى في أنظمة متطورة مثل OpenAI o1 و DeepSeekR1، والتي تستخدم الحوسبة وقت الاختبار للبحث والتعلم المعزز لتحسين الأداء. لكن على الرغم من هذا التقدم، تواجه المنهجيات الحالية تحديات جوهرية تعيق فعاليتها. فأساليب سلسلة الأفكار التسلسلية (Serialized chain-of-thought) تولد متواليات نتائج طويلة بشكل مفرط، مما يزيد من زمن الانتظار ويدفع بالحدود إلى حدود نوافذ السياق. أما الأساليب المتوازية، مثل أفضل-من-N (best-of-N) والاتساق الذاتي (self-consistency)، فتُعاني من ضعف التنسيق بين مسارات الاستدلال، ونقص في التحسين الشامل، مما يؤدي إلى عدم كفاءة الحوسبة وإمكانيات تحسين محدودة. كما تعتمد تقنيات البحث المُهيكلة وقت الاستدلال، مثل شجرة الأفكار (tree-of-thought)، على هياكل بحث مصممة يدوياً، مما يقيد مرونتها وقدرتها على التوسع عبر مهام وأنواع مختلفة من الاستدلال.

التحديات الحالية في الاستدلال بنماذج اللغات الكبيرة

تُبرز عدة نقاط التحديات الرئيسية في مجال الاستدلال باستخدام نماذج اللغات الكبيرة:

- طول متواليات النتائج: تُنتج الأساليب التسلسلية متواليات طويلة من النتائج، مما يؤدي إلى زيادة زمن الانتظار وتجاوز سعة نوافذ السياق.

- ضعف التنسيق في الأساليب المتوازية: تعاني الأساليب المتوازية من ضعف التنسيق بين مسارات الاستدلال، مما يؤدي إلى حسابات متكررة واستخدام غير فعال للموارد.

- هياكل البحث الثابتة: تعتمد بعض الأساليب على هياكل بحث ثابتة ومصممة يدوياً، مما يحد من مرونتها وقدرتها على التوسع.

- عدم الكفاءة في استخدام سعة نوافذ السياق: تُعاني بعض الأساليب من عدم كفاءة في استخدام سعة نوافذ السياق، مما يحد من قدرتها على معالجة المعلومات ذات الصلة.

الاستنتاج الموازي التكيفي (APR): حلٌّ ثوري

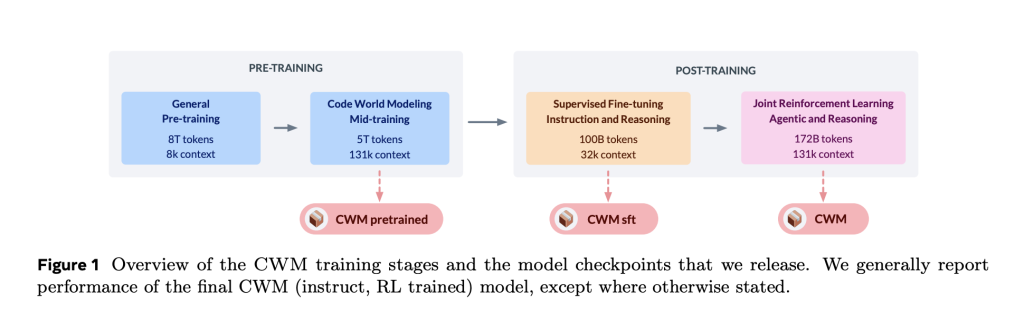

اقترح باحثون من جامعة كاليفورنيا، بيركلي، وجامعة كاليفورنيا، سان فرانسيسكو، نهجاً جديداً يُسمى الاستنتاج الموازي التكيفي (Adaptive Parallel Reasoning – APR). يُمكّن هذا النهج القوي نماذج اللغات الكبيرة من توزيع الحساب وقت الاستدلال ديناميكياً عبر العمليات التسلسلية والمتوازية على حد سواء. يُعمّم هذا النهج أساليب الاستدلال الحالية، بما في ذلك الاستدلال التسلسلي بسلسلة الأفكار، والاستدلال الموازي مع الاتساق الذاتي، والبحث المُهيكَل، من خلال تدريب النماذج على تحديد متى وكيف يُمكن موازاة عمليات الاستدلال، بدلاً من فرض هياكل بحث ثابتة.

ميزات APR الرئيسية:

- آلية الخيوط الأبوية-الفرعية: تسمح هذه الآلية لخيوط الاستدلال الأبوية بتفويض المهام الفرعية إلى خيوط فرعية متعددة عبر عملية

spawn()، مما يُمكّن من الاستكشاف الموازي لمسارات استدلال مختلفة. ثم تُعيد الخيوط الفرعية النتائج إلى الخيط الأبوي عبر عمليةjoin()، مما يسمح للأبوي بمواصلة فك التشفير بهذه المعلومات الجديدة. - التحسين بتعلم التعزيز الشامل: يُحسّن هذا النهج نجاح المهمة الإجمالي دون الحاجة إلى هياكل استدلال مُعرفة مسبقاً.

مزايا APR:

- أداء أعلى ضمن نوافذ سياق ثابتة: يُحسّن APR الأداء بشكل ملحوظ حتى مع نوافذ سياق محدودة.

- توسع أفضل مع زيادة ميزانيات الحوسبة: يتناسب أداء APR بشكل أفضل مع زيادة موارد الحوسبة المتاحة.

- أداء مُحسّن عند زمن انتظار مُعادل: يُحقق APR أداءً أفضل من الأساليب التقليدية مع نفس زمن الانتظار.

هيكلية APR وطريقة التدريب

تتكون بنية APR من ثلاثة مكونات رئيسية:

- نظام الاستدلال متعدد الخيوط: يسمح لخيوط الاستدلال الأبوية بإنشاء خيوط فرعية متعددة باستخدام عملية

spawn(msgs). تنفذ كل خيط فرعي استدلالاً مستقلاً، مع استخدام نفس نموذج اللغة. وعند اكتمال مهمة الخيط الفرعي، يُعيد النتائج إلى الخيط الأبوي عبر عمليةjoin(msg). - طريقة التدريب المكوّنة من مرحلتين:

- التعلم المُشرف: يستخدم APR في البداية التعلم المُشرف مع عروض توضيحية مُولدة آلياً، تتضمن استراتيجيات بحث عميقة وعرضية، مما يُنشئ أنماط بحث هجينة.

- التعلم المعزز الشامل: يُستخدم تعلم التعزيز الشامل مع GRPO (Gradient-based Policy Optimization) لتحسين استراتيجيات موازاة عمليات الاستدلال.

- التحسين عبر تعلم التعزيز: يُحسّن هذا النهج الأداء من خلال تعلم كيفية موازاة عمليات الاستدلال لتحقيق أقصى قدر من الكفاءة.

النتائج التجريبية

أظهرت النتائج التجريبية تفوق APR باستمرار على الأساليب التسلسلية من عدة جوانب، حيث حقق تحسينات ملحوظة في الدقة وكفاءة استخدام الموارد. وتُظهر المقارنة مع أساليب أخرى تفوق APR في مختلف المقاييس، بما في ذلك دقة أعلى، وكفاءة أكبر في استخدام نوافذ السياق، وتحسينات كبيرة في زمن الانتظار.

الخلاصة

يُمثل الاستنتاج الموازي التكيفي (APR) تقدماً هاماً في قدرات الاستدلال بنماذج اللغات الكبيرة، من خلال تمكينه من توزيع الحساب ديناميكياً عبر المسارات التسلسلية والمتوازية. يُزيل APR الحاجة إلى هياكل مُصممة يدوياً، ويُتيح للنماذج تطوير استراتيجيات موازاة مثالية. تُبرز النتائج التجريبية المزايا الكبيرة لـ APR، مما يُشير إلى إمكانات أنظمة الاستدلال التي تُهيكل عمليات الاستدلال ديناميكياً لتحقيق قابلية توسع وكفاءة مُحسّنة في مهام حلّ المشكلات المعقدة.

اترك تعليقاً